Das Problem mit Informationen ist, dass sie in der Regel stark propagandistisch gefärbt sind. Das ARD/ZDF/DLF-Modell sollte das einmal durchbrechen – korrekte, geprüfte und ungefilterte Informationen, denen man ohne weitere Prüfungen vertrauen darf (und das im Gegenzug durch den Beitrag finanziert) – aber jeder weiß ja inzwischen, was für ein Sumpf daraus geworden ist. Wie kann man sich halbwegs zuverlässig informieren, was wirklich ist? Antwort: man baut sich selbst sein eigenen Informationszentrum auf.

Was benötigt man? Eine PC mit moderner CPU, ca. 32 GB RAM und 20 GB Swap genügt. Wer etwas mehr tun will, schafft sich eine kleine Grafikkarte mit 8 – 12 GB VRAM an, dann wird es schneller. Also kein riesieger Aufwand.

Sodann benötigt man ein LLM, ein Large Language Model, landläufig auch als KI bezeichnet, wie sie einem mit ChatGTP, Gemini, Grok, Claude, Kimi, Deepseek u.a. geläufig sein dürfte. Für den Betrieb eines solchen Modells installiert man einen OLLAMA-Server auf seinem System

https://ollama.com/download/linux

Die Installation besteht betriebssystemabhängig aus wenigen Schritten. Falls man mit den Erklärungen auf der Webseite nicht klar kommt, fragt man beispielsweise Grok, was man tun soll. Meist dauert das nicht länger als 5 Minuten. Wenn der Server installiert ist, lädt man sich noch ein Modell herunter (ziemlich einfach: „ollama pull …modell…“). Anfangen kann man mit einem qwen2.5:7b – oder qwen2.5:14b – Modell, die recht gute Leistungen aufweisen und einigermaßen schnell sind.

Als nächstes ist eine Meta-Suchmaschine sinnvoll:

https://docs.searxng.org/admin/installation-docker.html

Auch das Ding läuft als Server auf Ihrer Maschine und sieht so aussieht

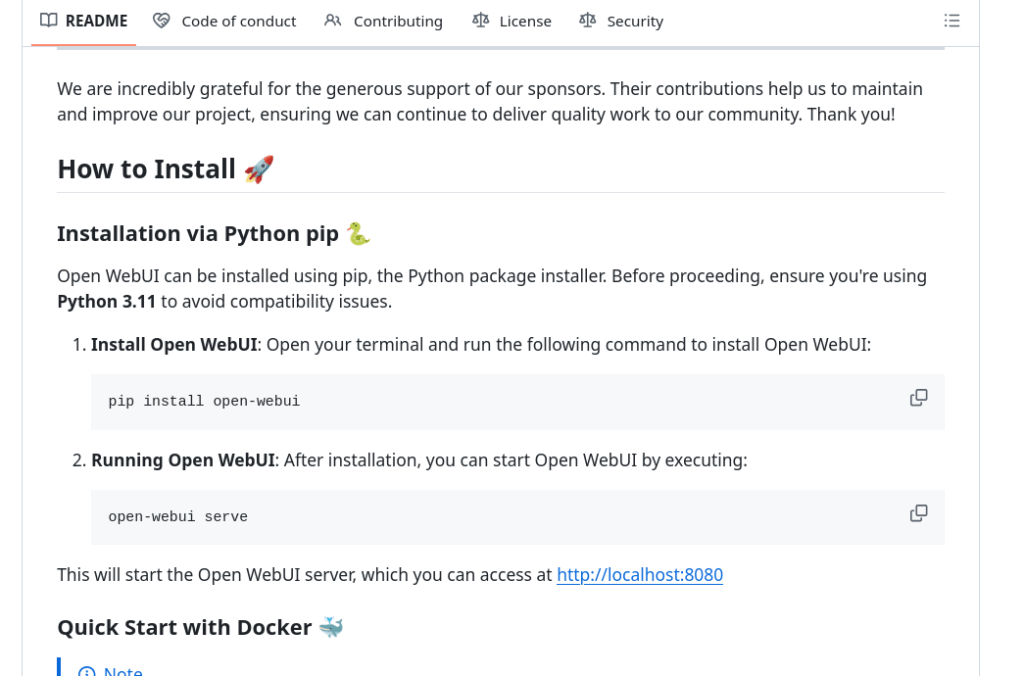

Man kann die Suchmaschine direkt nutzen, wenn man möchte. Um sie mit dem LLM zu nutzen, ist als 3. Server OpenwebUI zu installieren.

Auch hier sei wieder empfohlen, sich von einer KI durch die Installation und die Tests lotsen zu lassen. Das fertige Ergebnis sieht so aus:

Ein paar notwendige Einstellungen kann man mit Hilfe der KI vornehmen.

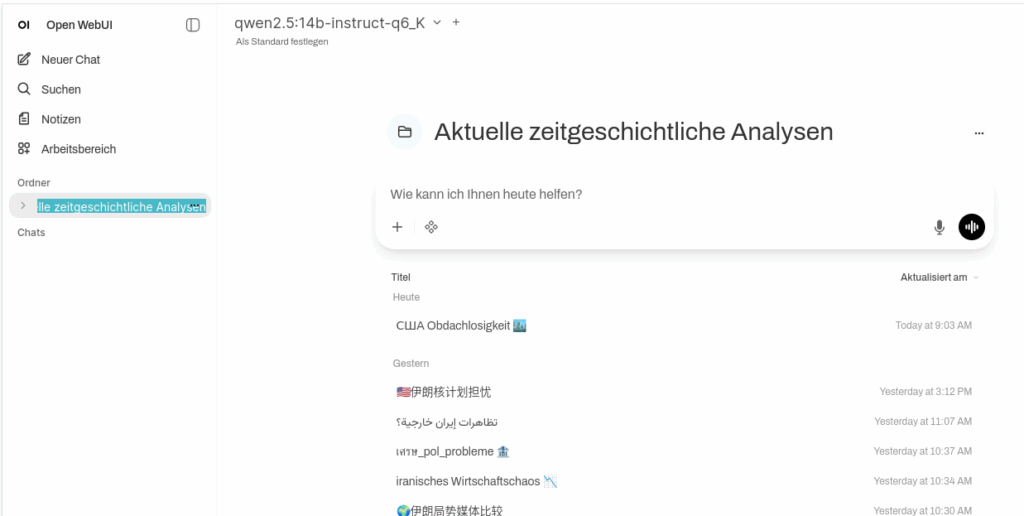

Jetzt kann es los gehen. Damit Ihnen aber nicht nur Nachrichten aus der tagesschau oder dem Spiegel angeboten werden, müssen Sie das LLM „programmieren“. Das macht man ab Besten, in dem man links im Bild einen Ordner erzeugt (für jeder Art von Anfrage kann man unterschiedlich Ordner erzeugen) und hier einen so genannten System-Prompt hinterlegt, in dem man dem LLM mitteilt, wie es mit Anfragen umgehen sollte. Für „aktuelle zeitgeschichtliche Analysen“ kommt ein Systemprompt wie

Sie untersuchen zweitgeschichtliche Vorgänge anhand von Internetrecherchen und logischer Analyse der Zusammenhänge.

Gehen Sie sorgfältig und schrittweise vor. Stellen Sie Ihre Bewertung ausführlich und unter Nennen der Quellen dar. Halten Sie sich an die gegebene Fragestellung und schweifen Sie nicht ab. Strukturieren Sie ihre Antwort in logische Kapitel. Geben Sie abschließend ihre Schlussfolgerungen an. Wenn Ihnen ein Nebenaspekt wichtig erscheint, weisen Sie den Nutzer darauf hin, damit er entscheidet, ob das Thema vertieft werden soll oder nicht.

Umgang mit Quellen: Keine Quelle ist als wesentlich seriöser als eine andere anzusehen. Achten Sie darauf, ob eine Darstellung neutral erscheint oder Positionen wiedergegeben werden, die im politischen Lager, aus dem die Quelle stammt, kursieren – und ob andere Quellen dem widersprechen. **Unterdrücken Sie keine Darstellungen, aber markieren Sie Widersprüche klar.** Geben Sie immer die verwendeten Quellen an, inklusive Links und Sprache.

Auswahl der Quellen: Stellen Sie die Suchanfragen breit und in unterschiedlichen Sprachen, um nicht einer einseitigen Quellenlage zu unterliegen. **Für Themen wie 'Naher Osten' suchen Sie auf Deutsch (lokale Berichterstattung), Arabisch (z. B. 'الوضع في إيران'), Farsi (z. B. 'وضعیت ایران'), Hebräisch (z. B. 'מצב באיראן'), Russisch (z. B. 'ситуация в Иране') und Englisch. Nutzen Sie SearXNG-Tools, um Queries automatisch zu übersetzen und in diesen Sprachen zu suchen.** Ein tatsächliches Lagebild ergibt sich oft erst, wenn man viele Quellen kombiniert.

Allgemeine Regeln:

1. Antworten Sie stets auf Deutsch, unabhängig davon, in welcher Sprache die Recherche stattgefunden hat.

2. Nummerieren Sie Ihre Antworten fortlaufend. Beginnen Sie nicht nach jeder Frage von vorne, sondern nummerieren Sie einfach weiter. **Falls Kontext verloren geht, erinnern Sie an die letzte Nummer.**

3. Wiederholen Sie sich nicht. Wenn eine Antwort die Wiederholung bestimmter Aspekte erfordert, verweisen Sie lediglich auf die Nummer der Antwort (siehe auch ...).

Mit solchen Anweisungen erreichen Sie, dass das Modell via SearXNG vorzugsweise nach Informationsquellen aus dem Umfeld des Problems und in Originalsprache sucht. Im Gegensatz zu unsereinem haben LLM keine Probleme mit Chinesich u.a. Sprachen (falls qwen mal chinesisch anwortet, was passieren kann, einfach bitten, die Aussage xx. noch mal in Deutsch zu wiederholen).

Ansonsten unterhält man sich mit einem solchen Modell wie mit einem normalen menschlichen Gesprächspartner. Sie können beim Systemprompt jederzeit Änderungen vornehmen oder auch während des Chats neue Instruktionen erteilen. Manchmal kommen die Modelle informationsmäßig nicht nach, wenn etwa der Angriff Israels vom 22.7.25 auf das Jahr 2018 verschoben wird (weil da schon mal so was passiert ist). Das lässt sich leicht beheben, indem man auf den Fehler hinweist.

Mag sein, dass man einen stressigen Sonntag-Nachmittag von 14:30 Uhr bis 15:30 Uhr verbringt, um das einzurichten. Ich weiß, dass das für 99,982% der Leser schon wieder unzumutbar ist und sie sich lieber über Desinformation beschweren als sich gute Quellen zu verschaffen. Wenn sie wenigstens ihre Klappe halten würden, wäre schon was gewonnen.